Dans le monde rapide du développement logiciel, le rythme du sprint est crucial. Pourtant, un point de friction courant perturbe ce flux : les histoires qui arrivent à la planification du sprint sans critères clairs de succès. Lorsqu’une équipe commence le développement sur une exigence floue, le coût des modifications augmente exponentiellement. En veillant à ce que les histoires utilisateur soient prêtes à être testéesavant le début du sprint, les équipes peuvent maintenir une vitesse constante et une qualité élevée.

Ce guide explore les mécanismes de préparation des histoires pour le test avant l’exécution du sprint. Nous examinerons la définition de prêt, l’architecture des critères d’acceptation, et les pratiques collaboratives qui permettent aux équipes de livrer de la valeur de manière cohérente sans accumulation de dette technique.

📉 Le coût caché du test tardif

Beaucoup d’équipes fonctionnent sous l’hypothèse que le test a lieu après l’écriture du code. Bien que cela soit traditionnel, cela crée un goulot d’étranglement pendant le sprint. Les défauts découverts tard dans le cycle sont considérablement plus coûteux à corriger que ceux identifiés pendant la phase de raffinement.

Pensez aux impacts suivants du démarrage d’un sprint avec des histoires non testées :

- Changement de contexte :Les développeurs doivent interrompre le codage pour clarifier les exigences au milieu du sprint.

- Travail non terminé :Les histoires peuvent rester en « En cours » car elles ne peuvent pas être vérifiées.

- Détérioration de la qualité :La dette technique s’accumule lorsque des raccourcis sont pris pour respecter le délai.

- Frustration de l’équipe :Les interruptions constantes rompent l’état de flux nécessaire à la résolution de problèmes complexes.

En déplaçant la discussion sur le test à la phase de raffinement, vous éloignez la complexité de la fenêtre d’exécution du sprint. Cela garantit que lorsque le travail commence, le chemin à suivre est clair.

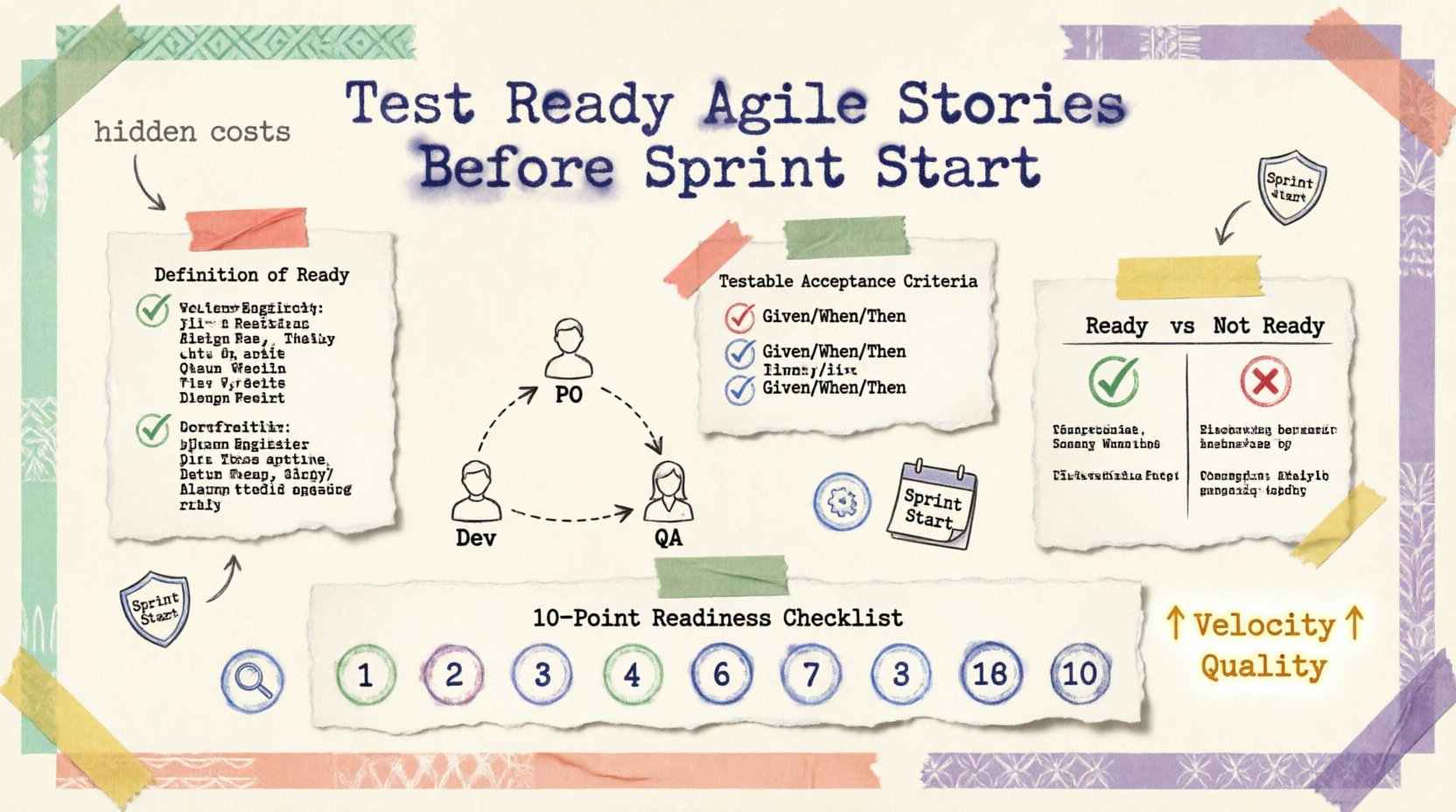

🛠️ La définition de prêt (DoR)

La définition de prêtest un accord partagé entre l’équipe selon lequel une histoire utilisateur remplit les conditions nécessaires pour être tirée dans un sprint. Ce n’est pas un garde-barrière, mais un filtre de qualité. Si une histoire ne remplit pas la DoR, elle reste dans le backlog pour un raffinement ultérieur.

Une histoire n’est pas prête si :

- La valeur métier est floue.

- Les critères d’acceptation sont manquants ou vagues.

- Les dépendances vis-à-vis d’autres équipes ou systèmes ne sont pas résolues.

- L’approche technique n’a pas été envisagée.

- Les exigences de données de test ne sont pas définies.

Assurer que la définition de prêt est respectée réduit la charge cognitive des développeurs. Ils n’ont pas besoin d’agir comme des détectives pour découvrir ce qui doit être construit ; ils agissent comme des constructeurs, car le plan est complet.

📝 Rédiger des critères d’acceptation testables

Les critères d’acceptation sont les conditions spécifiques que doit satisfaire un produit logiciel pour être accepté par un utilisateur ou un intervenant. Pour être efficaces, ces critères doivent être testables. Des énoncés vagues comme « Le système doit être rapide » ou « L’interface doit être jolie » ne peuvent pas être vérifiés de manière objective.

Pour rendre les critères testables, utilisez les stratégies suivantes :

- Soyez précis : Au lieu de « rapide », utilisez « se charge en moins de 2 secondes ».

- Définissez les cas limites : Que se passe-t-il si l’entrée est vide ? Et si l’utilisateur n’a pas de permissions ?

- Utilisez un langage basé sur des scénarios : Adoptez des formats comme Étant donné/Quand/Alors pour décrire le comportement.

- Identifiez les besoins en données : Précisez quelles données sont nécessaires pour exécuter le test (par exemple, « nécessite un utilisateur avec le rôle Administrateur »).

Lorsque les critères d’acceptation sont rédigés avec précision, la phase de test devient un exercice de vérification plutôt qu’une mission d’exploration.

📊 Prêt vs. Non prêt : Une comparaison

Le tableau suivant illustre la différence entre une histoire prête au développement et une autre qui ne l’est pas. Cette comparaison met en évidence les différences concrètes en termes de clarté et de testabilité.

| Fonctionnalité | Histoire non prête | Histoire prête au test |

|---|---|---|

| Clarté | « Améliorer la sécurité de la connexion. » | « Ajouter une authentification multifacteur à la connexion. » |

| Critères | « Rendre cela plus sûr. » | « L’utilisateur doit entrer le code envoyé par e-mail après le mot de passe. » |

| Dépendances | « Dépend de l’équipe d’authentification. » | « Point d’entrée de l’API d’authentification disponible à /api/v2/auth/mfa. » |

| Données de test | « Utilisez un utilisateur de test. » | « Utilisez l’ID utilisateur 123 avec l’e-mail [email protected] activé. » |

| Résultat | Clarification nécessaire pendant la sprint. | La vérification commence immédiatement après la construction. |

🤝 Collaboration et communication

La préparation des tests n’est pas la seule responsabilité de l’équipe de garantie de la qualité. Elle nécessite une collaboration impliquant le propriétaire du produit, les développeurs et les testeurs. Cela est souvent appelé l’approche des « Trois Amis », où ces trois rôles discutent d’une histoire avant qu’elle ne soit engagée dans une itération.

Responsabilités du propriétaire du produit :

- Préciser la valeur métier et l’intention de l’utilisateur.

- S’assurer que la priorité est alignée avec les objectifs de l’itération.

- Confirmer que l’histoire s’inscrit dans le plan de livraison actuel.

Responsabilités du développeur :

- Évaluer la faisabilité technique.

- Identifier les risques potentiels liés aux performances ou à la sécurité.

- Confirmer l’accès aux environnements ou outils nécessaires.

Responsabilités du QA/testeur :

- Identifier les cas limites manquants.

- Définir les besoins en données de test.

- Estimer l’effort nécessaire pour les tests.

Lorsque ces rôles entrent dans une discussion précoce, ils évitent les malentendus. Un développeur pourrait réaliser qu’une fonctionnalité est techniquement impossible à réaliser dans l’itération, tandis qu’un testeur pourrait remarquer qu’une exigence manque d’une stratégie de retour arrière.

🧩 Gestion des dépendances et contraintes

L’une des principales raisons pour lesquelles les histoires ne sont pas prêtes aux tests est la présence de dépendances non résolues. Une histoire pourrait être complète en isolation, mais inutilisable si elle dépend d’un système externe qui n’est pas encore déployé.

Avant qu’une histoire ne rejoigne l’itération, vérifiez les contraintes suivantes :

- API externes : Les points d’entrée sont-ils actifs ? La documentation est-elle à jour ?

- Services tiers : Disposons-nous de crédentiels valides pour les tests ?

- Modifications de base de données :Les migrations de schéma nécessaires sont-elles planifiées ?

- Infrastructure :La chaîne de déploiement est-elle configurée pour la nouvelle fonctionnalité ?

Si une dépendance est manquante, l’histoire doit être divisée ou reportée. Il vaut mieux livrer une petite tranche complète de fonctionnalité que de conserver une grande histoire qui ne peut pas être validée en raison de blocages externes.

🤖 Prêt à l’automatisation

Dans les pratiques agiles modernes, les tests sont souvent automatisés. Toutefois, des scripts d’automatisation ne peuvent pas être rédigés si les exigences de l’histoire sont floues. Pour soutenir l’intégration et la livraison continues, les histoires doivent être suffisamment stables pour pouvoir être automatisées.

Prenez en compte ces facteurs pour la préparation à l’automatisation :

- Identifiants stables : Les éléments d’interface utilisateur ou les points de terminaison API sont-ils susceptibles de changer fréquemment ?

- Environnement de test : Y a-t-il un environnement stable pour exécuter les suites automatisées ?

- Stratégie de simulation : Si les services externes sont indisponibles, peuvent-ils être simulés de manière fiable ?

- Impact des régressions : Ce changement affecte-t-il les tests automatisés existants ?

Écrire les scripts d’automatisation avant le début de la sprint peut réellement améliorer la vitesse de livraison. Lorsque le code est fusionné, les tests s’exécutent automatiquement, fournissant un retour immédiat sur la stabilité.

🧪 La stratégie de test

Même avec des histoires prêtes à être testées, une stratégie de test solide est nécessaire. Cette stratégie doit être définie pendant la phase de révision et approuvée par l’équipe.

Composants clés de la stratégie :

- Tests unitaires :Assure que les composants individuels fonctionnent correctement.

- Tests d’intégration :Vérifie que les différents modules fonctionnent ensemble.

- Tests bout en bout :Valide l’ensemble du parcours utilisateur.

- Tests de performance :Vérifie le comportement du système sous charge.

- Tests de sécurité :Identifie les vulnérabilités dans l’implémentation.

En définissant cette stratégie dès le début, l’équipe sait ce qu’elle doit attendre. Il n’y a aucune surprise pendant la sprint quant à la nécessité d’un test de performance ou de validation de sécurité.

📉 Métriques et mesure

Pour s’assurer que le processus de préparation des histoires à tester est efficace, les équipes doivent suivre des métriques spécifiques. Ces métriques aident à identifier les goulets d’étranglement et les domaines d’amélioration.

Métriques clés à surveiller :

- Taux de révision : Combien d’histoires sont révisées par semaine ?

- Taux de report : Combien d’histoires sont reportées au sprint suivant en raison d’un manque de préparation ?

- Taux d’échappement des défauts : Combien de bogues sont trouvés après le déploiement ?

- Vitesse de sprint : L’équipe livre-t-elle de manière cohérente le travail prévu ?

Si le taux de report est élevé, cela indique que des histoires sont acceptées dans le sprint sans satisfaire la définition de « prêt ». L’équipe devrait s’arrêter et améliorer le processus d’entrée.

🛡️ Gestion des cas limites et des modes de défaillance

Une histoire prête à être testée prend en compte les parcours de succès et les parcours d’échec. Les développeurs construisent souvent pour le parcours idéal, mais les utilisateurs rencontrent fréquemment des erreurs. Une histoire n’est pas prête si elle ne précise pas comment gérer les erreurs.

Exemples de modes de défaillance à définir :

- Que se passe-t-il si la connexion réseau tombe ?

- Que se passe-t-il si l’utilisateur soumet des données non valides ?

- Que se passe-t-il si le serveur renvoie une erreur 500 ?

- Quel est le message visible pour l’utilisateur pour chaque erreur ?

En définissant ces scénarios dès le départ, l’équipe évite l’ambiguïté du « corriger plus tard ». Cela conduit à un produit plus résilient et à une meilleure expérience utilisateur.

🔄 Boucles de retour continues

La préparation au test n’est pas un événement ponctuel. Elle fait partie d’une boucle de retour continue. Au fur et à mesure que le sprint progresse, de nouvelles informations peuvent apparaître et modifier les exigences. L’équipe doit être assez agile pour s’adapter tout en maintenant les normes de qualité établies lors de la réflexion.

Pendant le sprint, si un blocage est découvert sans avoir été anticipé lors de la réflexion :

- Mettre immédiatement l’activité en pause.

- Impliquer les parties prenantes nécessaires.

- Mettre à jour les critères d’acceptation.

- Réévaluer la préparation au test.

Cette agilité empêche l’équipe de construire quelque chose qui est techniquement correct mais fonctionnellement erroné.

🌱 Construction d’une culture de qualité

En fin de compte, la préparation au test concerne la culture. Elle exige un changement de mentalité où la qualité n’est pas une réflexion tardive mais une condition préalable. Lorsque l’équipe valorise la préparation au test, elle valorise le produit qu’elle construit.

Encourager une culture de qualité :

- Soutien de la direction :La direction doit privilégier la qualité plutôt que la vitesse.

- Propriété partagée : Tout le monde est responsable de la qualité du déploiement.

- Sécurité psychologique : Les membres de l’équipe doivent se sentir en sécurité pour dire « pas prêt » sans craindre de représailles.

- Récompenser la qualité :Reconnaissez les équipes qui maintiennent des normes élevées et des taux de défauts faibles.

Lorsque la qualité est intégrée dans la culture, la Définition de Prêt devient une étape naturelle du flux de travail plutôt qu’un obstacle bureaucratique.

🚦 Liste de contrôle finale pour la préparation de l’histoire

Avant qu’une histoire ne soit engagée dans un sprint, vérifiez la liste suivante :

- ✅ L’histoire est-elle rédigée dans un langage centré sur l’utilisateur ?

- ✅ Les critères d’acceptation sont-ils précis et mesurables ?

- ✅ Tous les cas limites ont-ils été identifiés et documentés ?

- ✅ Les dépendances sont-elles résolues ou clairement comprises ?

- ✅ Les données de test sont-elles disponibles ou peuvent-elles être générées ?

- ✅ L’approche technique est-elle approuvée par les développeurs ?

- ✅ L’environnement est-il accessible pour les tests ?

- ✅ Les scripts d’automatisation sont-ils prêts ou planifiés ?

- ✅ L’histoire s’inscrit-elle dans la capacité du sprint ?

- ✅ La Définition de Prêt a-t-elle été validée par l’équipe ?

Utiliser cette liste de contrôle garantit que chaque histoire entrant dans le sprint est prête pour réussir. Elle réduit au minimum les risques et maximise la capacité de l’équipe à livrer une valeur de manière cohérente.

🏁 Conclusion

Prioriser la préparation des tests avant le début du sprint est une décision stratégique qui porte ses fruits en termes de vitesse et de stabilité. Elle transforme le processus de développement d’un cycle réactif de correction de bogues en un flux proactif de livraison de fonctionnalités vérifiées. En respectant une Définition de Prêt solide, en rédigeant des critères d’acceptation précis et en favorisant une culture collaborative, les équipes peuvent atteindre une livraison prévisible sans sacrifier la qualité.

L’objectif n’est pas de ralentir, mais d’éliminer les friction. Lorsque les histoires sont prêtes aux tests, l’équipe avance avec un but clair et de la confiance. Cette approche construit une base durable pour le succès à long terme dans le développement logiciel agile.